6大顶尖大数据处理与分析工具与服务 赋能智能决策,释放数据价值

在数据爆炸的时代,高效、强大的数据处理与分析工具是企业挖掘数据金矿、驱动业务增长的核心引擎。从海量数据的存储、清洗、计算到可视化分析,一系列成熟的工具和服务构成了现代数据基础设施的支柱。本文将深入介绍六个目前业界公认的、用于大数据处理与分析的最佳工具及服务平台,为您的技术选型提供参考。

1. Apache Hadoop:分布式处理的基石

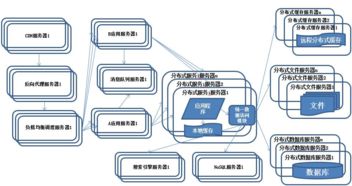

作为开源分布式计算框架的鼻祖之一,Hadoop以其HDFS(分布式文件系统)和MapReduce(编程模型)为核心,能够以可靠、可扩展的方式处理PB级别的数据集。它特别适合处理非结构化和半结构化数据的批处理任务。围绕其生态的Hive(数据仓库)、HBase(NoSQL数据库)等组件,共同构成了一个强大的离线数据处理生态系统,至今仍是许多企业大数据平台的底层基础。

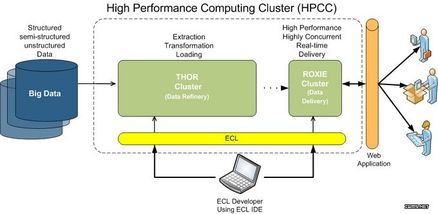

2. Apache Spark:高速统一分析引擎

Spark被誉为Hadoop MapReduce的“继任者”,其最大优势在于基于内存的计算,速度比Hadoop MapReduce快上百倍。它提供了一个统一的框架,支持批处理、交互式查询(Spark SQL)、实时流处理(Spark Streaming)、机器学习(MLlib)和图计算(GraphX)。其易用的API(支持Scala, Java, Python, R)和卓越的性能,使其成为当前进行复杂数据分析、机器学习和实时处理的优先选择。

3. Snowflake:云端原生数据仓库

Snowflake彻底革新了传统数据仓库的概念。它是一个完全托管、基于云的服务,将存储、计算与云服务层彻底分离。这种架构带来了无与伦比的弹性、可扩展性和易用性。用户可以独立扩展存储和计算资源,按使用量付费,并轻松地跨AWS、Azure、GCP等云平台共享数据。其高性能的SQL引擎和对半结构化数据(如JSON)的原生支持,使其成为现代数据湖仓一体化的理想选择。

4. Databricks:由Spark创始团队打造的Lakehouse平台

Databricks提供了一个统一的、基于云的数据、分析和AI协作平台。它首创了“Lakehouse”(湖仓一体)架构理念,结合了数据湖的灵活性与数据仓库的管理和性能。其核心引擎是高度优化的Apache Spark,并集成了Delta Lake(提供ACID事务)、MLflow(管理机器学习生命周期)和自动化ETL工具。Databricks极大地简化了从数据准备到高级分析和机器学习的工作流。

5. Google BigQuery:无服务器、高度可扩展的数据仓库

作为Google Cloud Platform的旗舰数据分析服务,BigQuery是一个完全托管、无服务器的企业级数据仓库。用户无需管理任何基础设施,只需将数据加载进来,即可使用标准SQL对海量数据集进行超高速的SQL查询。它具备强大的机器学习集成能力(通过BigQuery ML)和出色的地理空间分析功能。其按查询扫描的字节量付费的模式,对于间歇性或分析型负载极具成本效益。

6. Amazon EMR + AWS Glue:AWS生态的弹性处理与集成服务

在亚马逊云科技(AWS)生态中,Amazon EMR(弹性MapReduce)是一个托管集群平台,可轻松运行Hadoop、Spark、HBase、Presto等开源大数据框架,自动进行资源配置和扩展。而AWS Glue则是一个完全托管的ETL(提取、转换、加载)服务,它可以自动发现、编目数据,并生成代码来清洗、丰富和移动数据。两者结合,为用户在AWS上构建自动化、可扩展的数据处理管道提供了强大的一站式解决方案。

数据处理服务的关键考量

在选择工具或服务时,企业需综合评估:

- 数据类型与规模:是处理流数据还是批数据?数据量级如何?

- 性能要求:对查询速度、吞吐量和延迟的敏感度。

- 技术栈与团队技能:现有基础设施在云端还是本地?团队熟悉SQL还是编程?

- 总拥有成本(TCO):包括许可费、基础设施成本、运维人力成本。

- 生态集成:与现有数据源、BI工具(如Tableau, Power BI)及业务系统的对接能力。

****

无论是开源的Hadoop、Spark,还是云原生的Snowflake、BigQuery、Databricks和AWS组合,这些顶尖工具和服务都在持续推动大数据处理与分析能力的边界。没有“唯一最好”的选择,关键在于根据自身业务场景、技术架构和成本预算,选择最适合的“组合拳”,构建敏捷、高效、智能的数据驱动体系,从而将海量数据转化为切实的业务洞察与竞争优势。

如若转载,请注明出处:http://www.rikmuixpx.com/product/85.html

更新时间:2026-05-30 04:35:05