值得收藏 ETL工具与数据处理服务全方位解析

在数据驱动的时代,高效、可靠的数据处理是企业获取洞察、优化决策的核心基础。ETL(Extract, Transform, Load)工具及专业的数据处理服务,正是构建这一基础的关键技术栈。本文将系统梳理值得关注的ETL工具与数据处理服务,助您构建稳健的数据流水线。

一、ETL工具:数据管道的引擎

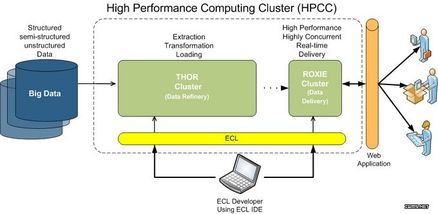

ETL工具负责从各类源头抽取数据,进行清洗、转换和整合,最终加载到目标数据仓库或数据湖中。其核心价值在于自动化、可靠性和效率。

1. 主流ETL工具概览

- 传统/企业级工具:

- Informatica PowerCenter:功能全面、稳定可靠,适合大型企业复杂集成场景,但成本较高。

- IBM InfoSphere DataStage:强大的并行处理能力,擅长处理海量数据。

- Oracle Data Integrator (ODI):与Oracle生态深度集成,声明式设计较为高效。

- 开源工具:

- Apache NiFi:基于流式架构,提供可视化界面,擅长处理实时数据流,灵活且社区活跃。

- Talend Open Studio:提供丰富的组件和图形化设计器,开源版本功能强大,是性价比之选。

- Apache Airflow:以工作流编排和调度见长,通过代码(Python)定义任务依赖,非常适合复杂调度和监控场景。

- Kettle (Pentaho Data Integration):老牌开源ETL工具,图形化操作简单易上手。

- 云原生与SaaS工具:

- AWS Glue:全托管的ETL服务,无服务器架构,与AWS数据生态无缝集成。

- Azure Data Factory:微软Azure云上的数据集成服务,提供可视化编排和混合数据集成能力。

- Google Cloud Dataflow:基于Apache Beam模型,统一了批处理和流处理。

- Fivetran / Stitch:主打零维护的、预构建连接器的SaaS ELT工具,自动化处理从源到数据仓库的管道。

选择建议:企业选择时应综合考虑数据量、实时性要求、技术栈(特别是云平台)、团队技能和预算。云上用户可优先考虑对应云厂商的托管服务以降低运维成本;追求灵活性和控制力的团队可评估开源方案;而对稳定性和全面支持有高要求的大型企业,传统商业工具仍是可靠选择。

二、数据处理服务:超越工具的综合解决方案

数据处理服务通常指由专业团队或平台提供的、涵盖数据集成、清洗、加工到交付的端到端服务。它不仅仅是工具的使用,更包括方法论、最佳实践和专家支持。

1. 服务内容与价值

- 咨询与设计:帮助企业规划数据架构,设计高效、可扩展的数据流水线。

- 实施与开发:根据需求,使用合适的工具开发和部署ETL/ELT流程。

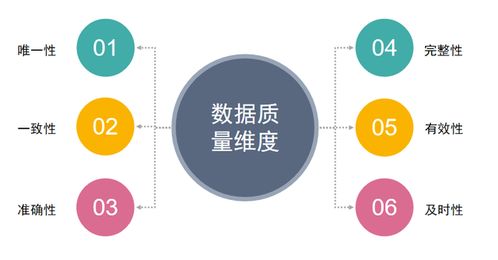

- 数据质量管控:建立数据质量规则,持续监控和修复数据问题,确保数据可信。

- 性能优化与运维:对现有流程进行调优,提供7x24小时监控与运维保障。

- 定制化开发:针对特殊数据格式或业务逻辑,开发定制化的处理组件或脚本。

2. 典型服务模式

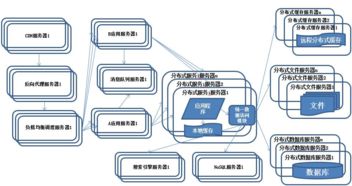

- 云厂商托管服务:如前述的AWS Glue、Azure Data Factory等,提供开箱即用、弹性伸缩的托管环境。

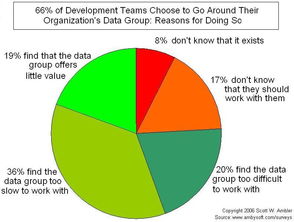

- 专业数据服务商:许多咨询公司和专业服务商提供从实施到运维的全套服务。

- 内部数据平台团队:大型企业常自建团队,基于开源或商业工具,为内部各业务部门提供数据处理服务。

选择建议:如果企业缺乏专业的数据工程团队或希望快速启动项目,采用专业的数据处理服务是高效的选择。评估服务商时,应重点考察其行业经验、技术能力、成功案例及对安全合规的承诺。

三、核心趋势与收藏要点

- ELT的兴起:随着云数据仓库(如Snowflake, BigQuery, Redshift)计算存储分离和强大SQL引擎的发展,ELT(先加载后转换)模式日益流行。工具选择需考虑对此模式的支持。

- 实时化与流处理:对实时洞察的需求推动着流式ETL工具(如Apache Flink, Kafka Streams)与服务的应用。

- 低代码/无代码与自动化:SaaS类工具和可视化平台降低了技术门槛,让业务人员也能参与数据管道构建。

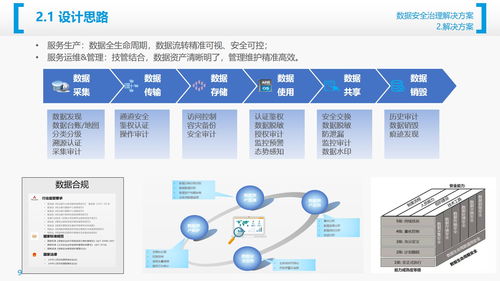

- 数据治理与质量内嵌:优秀的工具和服务越来越注重将数据质量检查、血缘分析和治理规则嵌入处理流程。

收藏与学习资源:

- 官方文档与教程:任何工具的首选学习路径。

- GitHub仓库:关注Apache项目及主流开源工具的官方Repo,了解最新动态和样例。

- 技术社区与博客:如Medium、Towards Data Science、各云厂商技术博客。

- 在线课程与认证:Coursera, Udemy上的相关课程,以及AWS、Azure等云平台的专项认证。

###

构建高效的数据处理能力,是数字化转型的关键一步。ETL工具是重要的技术武器,而专业的数据处理服务则能提供从战略到落地的全方位支持。无论是选择自建还是借助外力,理解工具特性、把握行业趋势、并持续关注数据质量与治理,方能在数据洪流中淘得真金,真正释放数据的商业价值。建议根据自身实际情况,将本文提及的工具与服务作为一份动态的“收藏清单”,在实践中不断评估与优化。

如若转载,请注明出处:http://www.rikmuixpx.com/product/79.html

更新时间:2026-05-24 20:29:10